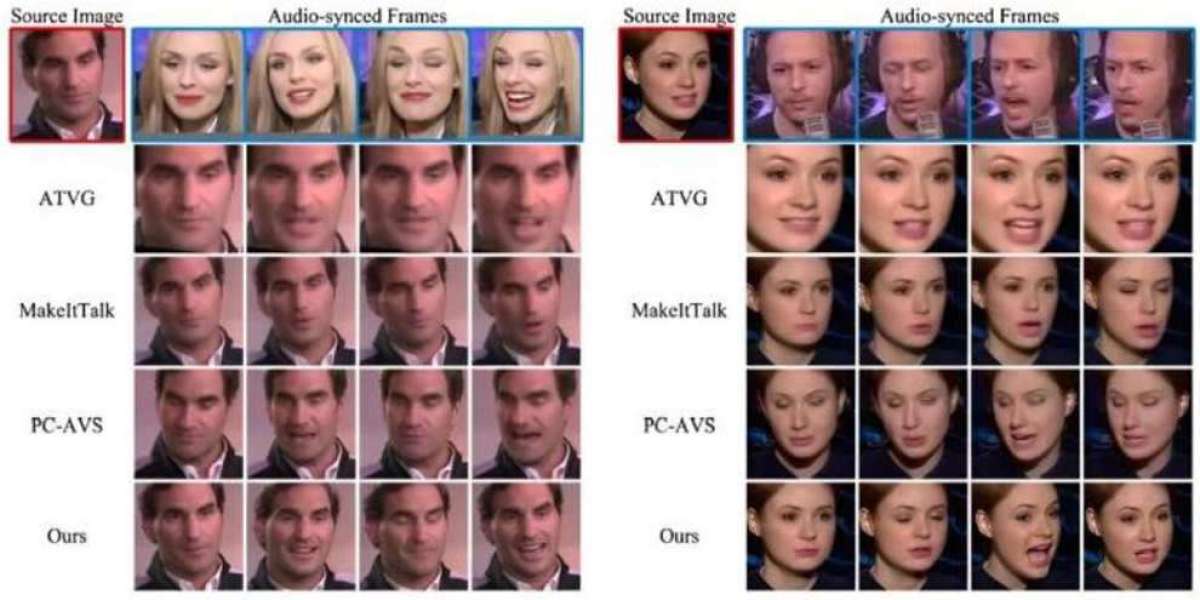

La generazione di volti parlanti basata sull'audio, che mira a sintetizzare i volti parlanti con animazioni facciali realistiche (compresi movimenti accurati delle labbra, dettagli vividi delle espressioni facciali e pose naturali della testa) corrispondenti all'audio, ha ottenuto rapidi progressi negli ultimi anni.

Un team di ricercatori guidati dal Prof Assoc Lu Shijian della NTU School of Computer Science and Engineering ha sviluppato un programma per computer che crea video realistici che riflettono le espressioni facciali e i movimenti della testa della persona che parla, richiedendo solo una clip audio e una foto del viso.

Il programma, chiamato "DIverse yet Realistic Facial Animations" (DIRFA), è basato sull'intelligenza artificiale che acquisisce audio e foto e produce un video 3D che mostra la persona che mostra animazioni facciali realistiche e coerenti sincronizzate con l'audio parlato. Il programma sviluppato da NTU migliora gli approcci esistenti, che lottano con le variazioni di posa e il controllo emotivo.

Per raggiungere questo obiettivo, il team ha addestrato DIRFA su oltre 1 milione di clip audiovisivi di più di 6.000 persone derivati da un database open source per prevedere i segnali del parlato e associarli alle espressioni facciali e ai movimenti della testa.

I ricercatori hanno affermato che DIRFA potrebbe portare a nuove applicazioni in vari settori e domini, inclusa l’assistenza sanitaria, in quanto potrebbe consentire assistenti virtuali e chatbot più sofisticati e realistici, migliorando l’esperienza degli utenti. Potrebbe anche fungere da potente strumento per individui con disabilità motorie o facciali, aiutandoli a trasmettere i propri pensieri ed emozioni attraverso avatar espressivi o rappresentazioni digitali, migliorando la loro capacità di comunicare.

Oltre ad aggiungere ulteriori opzioni e miglioramenti all'interfaccia di DIRFA, i ricercatori della NTU metteranno a punto le sue espressioni facciali con una gamma più ampia di set di dati che includono espressioni facciali e clip audio vocali più varie.