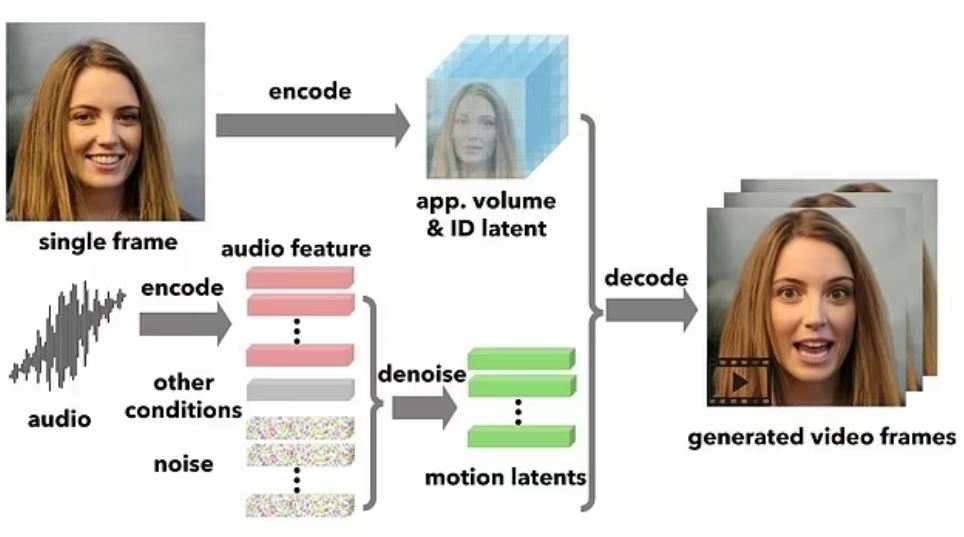

Il confine tra ciò che è reale e ciò che non lo è diventa sempre più sottile grazie a un nuovo strumento AI di Microsoft VASA-1 che può generare clip di persone che parlano da un'immagine fissa e dall'audio di qualcuno che parla, ma il colosso della tecnologia non lo rilascerà presto.

In un post sul blog, i ricercatori Microsoft descrivono VASA come un "framework per generare volti parlanti realistici di personaggi virtuali". L'intelligenza artificiale è stata addestrata con una libreria di espressioni facciali, che le consente persino di animare l'immagine fissa anche in tempo reale, così come viene parlato l'audio.

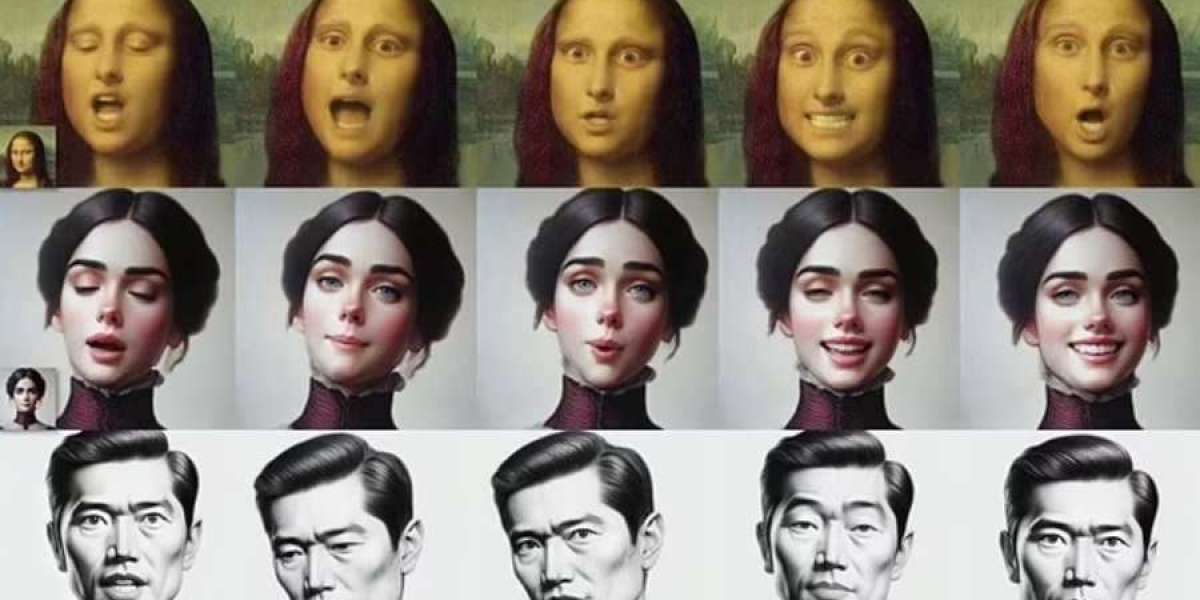

Quindi, VASA-1 acquisisce un'immagine statica di un volto, che si tratti di una foto di una persona reale o di un'opera d'arte o di un disegno di qualcuno di fantasia. Poi "meticolosamente" l'abbina all'audio del discorso per far prendere vita al volto. I movimenti delle labbra sono "squisitamente sincronizzati" con l'audio per far sembrare che il soggetto abbia preso vita, afferma il gigante della tecnologia. In un esempio, il capolavoro di Leonardo da Vinci del XVI secolo, "La Gioconda", inizia a rappare in modo rozzo con un accento americano.

In termini di casi d'uso, il team ritiene che VASA-1 "apre la strada a interazioni in tempo reale con avatar realistici che emulano comportamenti di conversazione umani".

"Il nostro metodo è in grado non solo di produrre una preziosa sincronizzazione labiale-audio, ma anche di catturare un ampio spettro di emozioni, sfumature espressive del viso e movimenti naturali della testa che contribuiscono alla percezione di realismo e vivacità", affermano.

Tuttavia, gli esperti hanno condiviso le loro preoccupazioni riguardo alla tecnologia, che se rilasciata potrebbe far sembrare che le persone dicano cose che non hanno mai detto. Un altro potenziale rischio è la frode, poiché le persone online potrebbero essere ingannate da un messaggio falso proveniente dall'immagine di qualcuno di cui si fidano.

Jake Moore, specialista in sicurezza presso ESET, ha affermato che "vedere è sicuramente non credere più". "Con il miglioramento di questa tecnologia, è una corsa contro il tempo per assicurarsi che tutti siano pienamente consapevoli di ciò che è possibile e che dovrebbero pensarci due volte prima di accettare la corrispondenza come autentica", ha detto.

Anticipando le preoccupazioni che il pubblico potrebbe avere, gli esperti Microsoft hanno affermato che VASA-1 "non è destinato a creare contenuti utilizzati per fuorviare o ingannare". Microsoft ammette che le tecniche esistenti sono ancora lontane dal "raggiungere l'autenticità dei volti parlanti naturali", ma la capacità dell'intelligenza artificiale sta crescendo rapidamente.

Tuttavia, secondo i ricercatori dell’Australian National University, i volti falsi realizzati dall’intelligenza artificiale sembrano più realistici dei volti umani. Questi esperti hanno avvertito che le rappresentazioni delle persone basate sull’intelligenza artificiale tendono ad avere un “iperrealismo”, con volti più sproporzionati, e le persone lo scambiano come un segno di umanità.

Un altro studio condotto da esperti della Lancaster University ha scoperto che i volti falsi dell’intelligenza artificiale sembrano più affidabili, il che ha implicazioni per la privacy online.