Il bizzarro sondaggio sull'intelligenza artificiale ha scioccato i lettori

Microsoft ha interrotto tutti i suoi #sondaggi generati dall'intelligenza artificiale sugli #articoli di #notizie e ha avviato un'indagine dopo che il Guardian Media Group ha #criticato il colosso della #tecnologia per un sondaggio che correva accanto a una storia sulla #morte di una donna.

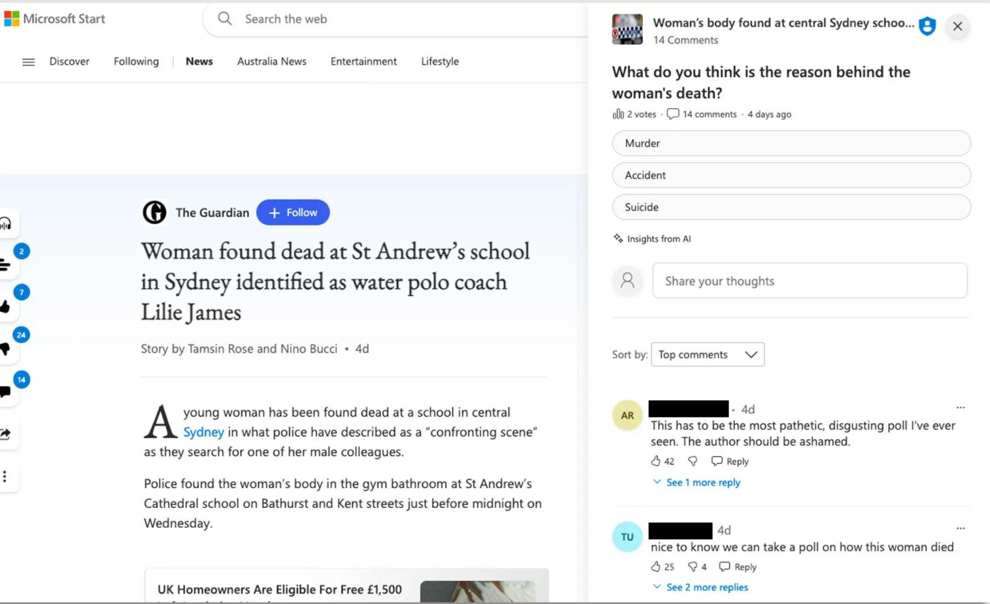

Retroscena: Martedì, il #guardian Media Group ha chiesto a #microsoft di assumersi la responsabilità pubblica del sondaggio, che correva accanto a un articolo su una donna trovata morta in una scuola in Australia, secondo una lettera ottenuta da Axios.

Il sondaggio, condotto all'interno della #piattaforma di aggregazione di notizie #microsoft_start, curata da Microsoft, chiedeva al lettore quale pensava fosse la causa della morte della donna: suicidio, omicidio o incidente, e i lettori potevano #votare sulla causa della morte.

Inutile dire che i lettori sono rimasti scioccati da un simile sondaggio e si sono chiesti chi potesse essere così insensibile e #pubblicare sondaggi così bizzarri relativi alla morte di un giovane. La risposta a questa domanda è l’ #intelligenza_artificiale.

"Si tratta chiaramente di un uso inappropriato della #genai da parte di Microsoft su una storia di interesse pubblico potenzialmente angosciante, originariamente scritta e pubblicata dai #giornalisti del Guardian", ha scritto l'amministratore delegato del Guardian Anna Bateson al presidente di Microsoft Brad Smith. Lei ha sottolineato che un simile sondaggio, oltre a creare ulteriore stress alla famiglia, ha anche un effetto negativo sulla reputazione dei giornalisti che hanno scritto l'articolo.

Anche se alla fine Microsoft ha rimosso il sondaggio, il danno era già fatto. I lettori hanno criticato il Guardian e l'autore dell'articolo nella sezione dei commenti del sondaggio, che ritenevano responsabili dell'errore perché i lettori pensavano che il sondaggio fosse stato organizzato dai giornalisti e non dall’intelligenza artificiale.

A proposito, questa non è la prima volta che l'intelligenza artificiale di Microsoft commette un simile errore legato alla morte di una persona, e a settembre è stato annunciato sul sito MSN che il defunto giocatore di basket Brandon Hunter è diventato inutile all'età di anni 42.

https://www.axios.com/2023/10/....31/guardian-microsof